本篇目录:

- 1、一、音视频基础知识

- 2、请教android中的TimedEventQueue问题

- 3、如何在Android上快速显示yuv数据

- 4、MediaCodec编码遇到android.media.MediaCodec$CodecException

- 5、androidaudio播放电台卡顿

一、音视频基础知识

把编码后的音视频数据以一定格式封装到一个容器中,封装格式有mkv、avi、ts等。码率也就是比特率,比特率是单位时间播放连续的媒体(如压缩后的音频或视频)的比特数量。比特率越高,带宽消耗得越多。

GOP( Group Of Picture ),表示一组图片,两个I帧之间就形成的一组图片。通常在为编码器设置参数的时候,必须要设置 gop_size 的值,其代表的是两个I帧之间的帧数目。

音视频同步概念: DTS(Decoding Time Stamp):即解码时间戳,这个时间戳的意义在于告诉播放器该在什么时候解码这一帧的数据。

音视频采集主要依赖视频、音频硬件采集设备。 视频采集图像传感器(CCD或CMOS等),用于图像采集和处理的过程,把图像转换成电信号。 拾音器、麦克风(声音传感器),用于声音采集和处理的过程,把声音转换成电信号。

本文将视频相关的理论知识与基础概念划分为 11 个知识点,如下: 根据人眼视觉暂留原理,每秒超过 24 帧的图像变化看上去是平滑连续的,这样的连续画面叫视频。 分辨率是以横向和纵向的像素数量来衡量的,表示平面图像的精细程度。

音视频是分开解释的:音频是正常人耳能听到的,相应于正弦声波的任何频率。正常人耳的音频范围一般约为16Hz~16kHz。视频泛指将一系列静态影像以电信号方式加以捕捉,纪录,处理,储存,传送,与重现的各种技术。

请教android中的TimedEventQueue问题

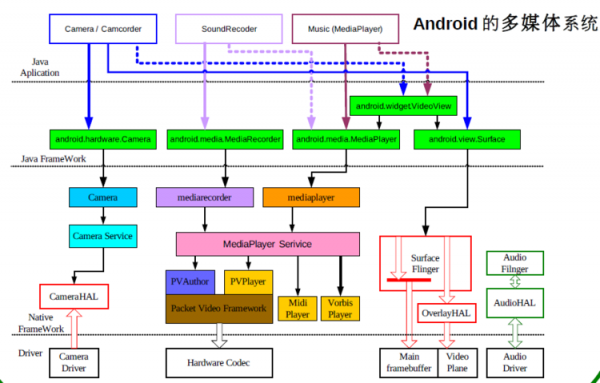

1、Android froyo版本多媒体引擎做了变动,新添加了stagefright框架,并且默认情况android选择stagefright,并没有完全抛弃opencore,主要是做了一个OMX层,仅仅是对 opencore的omx-component部分做了引用。

如何在Android上快速显示yuv数据

1、但即使这样,Android2中,在surfaceflinger层,是支持YUV420的,camera输出大都是YUV啊。

2、android是不可以在NDK部分直接采集yuv图像的,采集图像要用电脑中的扫描仪。

3、yuv视频格式就简单一些了,其实就是YUV格式图片组成的图像序列,可以保存为YUV4:2:0,4:2:2,4:4:4等格式,有些YUV视频格式文件可以通过MPEG-4andH.264解码器解码。yuv文件可以用一些专用的播放器来打开。

MediaCodec编码遇到android.media.MediaCodec$CodecException

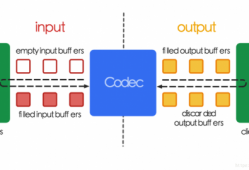

1、如果我们使用 MediaCodec.createDecoderByType(Mediaformat.MIMETYPE_VIDEO_AVC) 来创建MediaCodec,那么会使用第一个匹配的 OMX.qcom.video.encoder.avc ,如果我们使用了 COLOR_FormatYUV420Planar ,那么就会报错。

2、配置编码器,设置各种编码器参数(MediaFormat),这个类包含了比特率、帧率、关键帧间隔时间等。

3、使用 MediaCodecList 创建一个指定 MediaFormat 的MediaCodec。

androidaudio播放电台卡顿

1、从0版本开始,audio组件不再维护。所以建议使用能力更强的wx.createInnerAudioContext 接口。

2、重启手机。若无效,备份数据,将手机恢复出厂设置。若问题依然存在,有可能是内部硬件出现问题,建议您携带手机三包凭证,将手机送至就近的三星服务中心由工程师检查机器。

3、网络波动 视频是一帧一帧连续的图像构成的,在播放过程中,如果无法按时渲染,则会出现卡顿的效果;如果丢失几帧画面,则会出现快进效果。

4、解析有问题,你检查下解析使用的对象是不是 多写东西了。另外你打印出xml数据检查下xml数据有没有问题。

5、unity播放audiosource卡顿时有两种解决方法使用流(Streaming)载入方式(Load&Type),并且设置压缩格式(Compression&Format)为Vorbis。使用压缩并存储至内存(CompressedIn&Memory)载入方式,设置压缩格式为Vorbis。

到此,以上就是小编对于的问题就介绍到这了,希望介绍的几点解答对大家有用,有任何问题和不懂的,欢迎各位老师在评论区讨论,给我留言。

发表评论